하루에 2억 5천만 개의 트윗을 저장, 해설하는 트위터가 4월 12일 MySQL 컨퍼런스에서 자사의 기술적 노하우를 공개하겠다고 한다. 블로터닷넷은 이 기사를 아래와 같이 옮겼다,

하루 평균 트위터가 저장하고 처리하는 트윗은 약 2억5천만건으로, 이를 어떻게 하면 MySQL 이점을 살리면서도 확장성을 갖출 수 있는지를 연구하기 시작했다. 과거 트위터는 이 트윗 데이터를 날짜 기준으로 분할해 관리하는 방법을 사용했다. 그 결과 오래된 트윗은 트래픽은 높지 않지만 점점 서버 용량을 차지했고, 새로운 트윗을 정리하기 위해 서버를 추가로 구입하는 상황이 벌어졌다. 트위터 설명에 따르면, 약 3주에 한 번씩 서버를 추가하는 꼴이었다고 한다.

이 문제를 해결하기 위해 트위터는 데이터 분산도구로 기저드(Gizzard), 데이터 저장소로는 MySQL, 아이디 생성에는 스노우플레이크라는 오픈소스 도구로 새롭게 데이터 분산 환경을 재구성했다. 그 작업물을 이번에 오픈소스로 공개했다. (http://www.bloter.net/archives/104962)

근데... 현실적으로 이 기술을 적용하려면 내가 만든, 운영하는 사이트가 트위터와 근접하거나 최소한 좀 비슷한 수준이어야 할텐데? 결국 아주 멋지고 훌륭한 뻘소리다. 나는 MySQL을 최적화하지 않아도 충분한 서비스 '따위'를 운영하고 있거든. 그들의 열린 마음에 감사하지만 왜 이렇게 속상할까? ㅜ.ㅜ

그래도 공개하면 읽어보긴 할 것 같다 :-)

'Web Insight' 카테고리의 다른 글

| NHN 이해진, "직원들 빠졌다" 질타 (3) | 2012.04.16 |

|---|---|

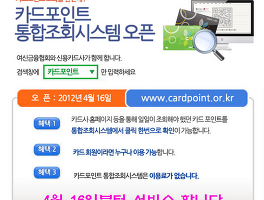

| 카드포인트통합사이트, cardpoint.or.kr (2) | 2012.04.16 |

| 네이버의 사이트 불안정 아이콘 (2) | 2012.04.10 |

| 미디어오늘의 투쟁 저널리즘 (0) | 2012.04.09 |

| 흔적없이 사라진 OpenID (1) | 2012.04.04 |